说实话,我以前是真没把AI检测这玩意儿当回事。总觉得它就是跟查重差不多,不就是看看你的东西是不是抄的嘛。结果今年上半年,我一个做自媒体的朋友直接翻车了——辛辛苦苦肝了一周的公众号长文,发布不到两小时就被平台限流了,后台数据惨不忍睹。他截图发过来问我:“哥,我这篇也没抄谁啊,咋就不行了?”

我当时一看他那文章,心里就有数了。整篇文风特别平,开头是“随着互联网的发展”,中间是“首先、其次、最后”,结尾是“综上所述”——这味儿也太冲了。我跟他开玩笑说:“你这篇文章要是拿去喂AI,它自己都得怀疑是它写的。”后来他用一款AI检测助手跑了一遍,AI率直接飙到70%以上。那一刻他才意识到,自己写的“干货”,在算法眼里就是标准的AI流水账。

这事儿给我敲了个警钟。现在做内容真的变了,不是说文章写得漂亮就行,你还得让你的文字看起来“像人写的”。

AI检测到底在检测什么?你搞懂了就不怕了

我花了很长时间去研究这个事儿。原来AI检测系统跟论文查重完全是两码事。查重是看你有没有跟别人的文章重复,而AI检测是在分析你的文本“长得像不像AI写的”。它会看你的句子结构是不是太工整、用词是不是太标准化、段落之间的信息密度是不是太均匀,连全文的风格变化它都给你算进去——但凡从头到尾一个味儿,它就怀疑你是AI-5。

为什么AI写的东西容易被抓?因为大语言模型本质上就是个“概率预测器”,它每写一个词都是按统计概率算出来的,所以在词汇多样性、句法结构、语义一致性上都特别规律。说白了,就是太标准了,标准到不像一个正常人有情绪、有跳跃、有瑕疵-24。

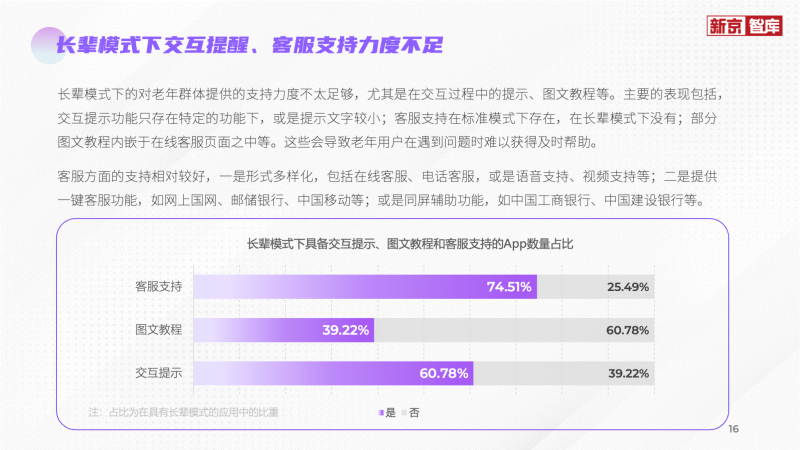

最坑的是什么?不同平台的检测算法差异极大。同一篇文章,知网给你标个35%,维普可能只有18%,万方可能更友好,只给12%。你拿一个免费工具测出来AI率偏高,按它的提示改完,再拿去学校用知网一查,结果不降反升——因为你按A平台的逻辑改的,B平台根本不认-5。这种情况在今年的毕业生群体里特别多,有人说去年年底查AI率18%还能过,今年一个字没改,重查直接飙到30%以上,就因为检测算法更新了-5。

后来我用一款好用的AI检测助手反复测试对比,才慢慢摸清楚不同平台的脾气。说实话,国内工具和国外工具对中文内容的识别能力差别非常大,Copyleaks这类国外工具核心能力都建立在英文语料库上,对中文长句的断句识别经常出错,正常手写的都能给你判定成AI,而且价格还贵,一个月几百块-1。你要做中文内容,老老实实选针对中文场景优化的工具才靠谱。

谁需要关注AI检测?可能比你想的更多

以前我觉得只有大学生论文才关心这个,后来发现完全不是。做小红书、公众号、头条号的自媒体创作者,发出去的内容会直接过平台的AI检测和风控系统,AI率高了直接被限流、限流、再限流,你不改它就不给你流量-1。做SEO网站优化的,引擎现在也在用AI检测来评判内容质量。还有各行各业的报告、方案,但凡涉及正式提交的东西,现在都有被AI检测卡住的风险。2026年高校对AI率的管控已经非常严格了,多数院校要求AI率不超过20%-30%,部分985、211的研究生论文甚至卡到了15%,不过这一关可能延迟答辩-5。

怎么让文字更有人味儿?我从小白到老手的几个土办法

我踩了这么多坑,也总结出了一些让文字更有人味儿的土办法,都是亲测有效的。

第一,打破AI的模板化用词。你打开自己写的东西,看看有没有“首先、其次、最后”“近年来”“随着社会的发展”“综上所述”这些词,有的话赶紧换。比如“首先、其次、最后”换成“先说、再说、到最后吧”,“近年来”换成“最近这两年”“前几年那会儿”,感觉完全不一样-28。

第二,用具体的东西替换抽象的表达。AI特别爱用那种特别虚的套话,什么“随着人工智能技术的发展,其在教育领域的应用越来越广泛”。你换成“2023年到2025年这两年,AI技术变化特别快,像什么机器学习、自然语言处理这些东西,已经在大学上课、学生在线问问题、自动批改作业这些地方慢慢用起来了”,是不是感觉一下就活了?有血有肉,像一个正常人在聊天-28。

第三,打破语言的平整感。人类说话是有节奏感的,有长有短、有停顿有跳跃。你写的时候刻意制造一些错落,该短的地方短一点,该啰嗦的地方啰嗦一点,甚至故意留一两个不那么完美的句子,这才是真实的人类写作状态。

我现在的习惯是先用AI检测助手把整篇文章跑一遍,找到AI痕迹最重的问题段落,然后手动重写,最后再检测一遍确认效果-1。说实话,你真正用心写出来的东西,跟AI批量生成的那些东西,读者一眼就能分辨出来。检测工具只是一个帮手,帮你发现哪里不对劲,但真正的核心永远是你提供给读者的那些有价值的信息。工具能告诉你AI痕迹有多明显,但决定读者喜不喜欢你的,永远是你说了什么有用的话。

文章结尾了,我看不少朋友之前都私信我问过各种各样的问题,正好今天在这统一聊聊大家问得最多的几个。挑了几个有代表性的,都是真实遇到过的情况,我把回答也写出来了,希望对大家有帮助。

网友@新媒体运营打工人阿杰 问:做自媒体的AI率控制到多少比较保险?是不是越低越好?会不会影响账号权重?

这个问题问得很实在,我分几点说清楚。

AI率不是越低就一定越好。检测系统看的是文本特征,你写得特别自然、特别口语化、特别有人味儿,AI率反而会高?恰恰相反,真正像人类写的文章,在检测系统里呈现的AI率通常是很低的。关键是你的文章有没有“人味儿”。我见过AI率才5%的文章,读起来干巴巴的全是套话,也见过AI率20%左右的文章读着特别舒服自然。所以你不用盲目追求个位数的AI率,保持在10%-20%之间是比较安全的区间,重点放在内容质量和表达的自然度上。

关于账号权重,目前主流的内容平台(比如公众号、小红书、头条号)确实会通过AI检测来评估内容质量。但这不代表AI率稍高一点就直接判你死刑,平台的核心逻辑始终是“用户喜欢什么就推什么”。如果你的文章AI率偏高,但用户阅读时长很长、互动数据很好,平台照样会给流量。反过来,AI率再低,读者打开两秒就关了,也一样没戏。所以你要盯的核心指标是完读率、点赞、评论、收藏这些用户反馈,这些才是平台真正看重的东西。

最后给个小建议:发正式文章之前先检测一下AI率,如果超过30%就主动做一轮人工润色再发。不要等平台判了再改,那时候流量已经浪费了。我自己的经验是,用AI检测助手找出问题段落之后,重点改开头、小标题、过渡句这三块,通常能把AI率从30%以上拉到15%以下,效果很明显。

网友@研三论文困在知网里 问:知网检测的AI率跟其他免费工具测出来的差太多怎么办?该信哪个?

这个问题我太有体会了。我说一个真实经历,今年上半年有个师弟论文送审前,先用某个免费工具测出来AI率只有12%,他觉得自己稳了就直接提交了,结果知网查出来36%,直接被导师退回来重改,差点影响答辩。这绝对不是个例。

先说结论:学校用什么检测系统,你就用匹配那个系统的工具。知网检测算法是保密的,市面上没有任何一款免费工具能100%复现知网的检测逻辑。你要以学校最终的检测结果为准,而不是你平时测试用的那些工具。很多免费检测平台自己有降AI功能,你用它的逻辑改完了,再拿知网一查,结果可能完全两样——因为你按A平台的算法改的,B平台根本不认-5。

那怎么办?我说三条建议。第一,初稿阶段可以用免费工具做筛查,找找AI痕迹比较明显的段落,但不要把它测出来的AI率当成最终参考值。第二,提交终稿之前,最好花钱找知网同源的渠道测一次(市面上有一些平台跟知网算法接近,虽然不能100%复现但参考价值大很多)。第三,也是最关键的,与其花大量精力去追一个虚无缥缈的低AI率数字,不如老老实实把论文写得扎实一点、具体一点、有自己的观点和分析。我认识的很多同学,论文写得特别认真、全是自己的实验数据和思考,AI率自然就很低,根本不用专门去降。

网友@自由撰稿人林小美 问:用AI辅助写初稿,人工改完之后AI率还是下不来,是不是白改了?

这个问题问出了很多人的心声。我看过太多人做白费力气的改稿——花了一个下午把同义词换了一轮,结果AI率一动没动。为啥?因为AI检测看的不只是你有没有换词,而是你的文本整体特征有没有改变-24。

如果你只是把“重要”换成“关键”,把“首先”换成“第一”,相当于只是在同一个锅里换了几个调料,汤底还是那个汤底,检测系统一眼就能看出来。要打破AI的识别,你得从三个维度同时动手:词汇替换、句式重组、风格变化。你光改词汇,句法结构还是AI那一套,没用;光调语序,词汇多样性还是不够,也没用。

我个人的经验是三步走。第一步,先用检测工具把全文跑一遍,标记出AI痕迹最重的段落(通常是开头、小标题附近、过渡段落这些地方)。第二步,重点改那些“AI高频词”——比如“研究表明”“综上所述”“首先其次最后”这种模板化表达,换成你自己说话的方式。举个例子,AI爱写“通过问卷调查收集数据,对数据进行统计分析”,你改成“数据收完以后,我先用问卷把样本理了一遍,再用软件把数据跑了一遍统计分析”——立马就不一样了-28。第三步,改完之后把文章晾一晚上,第二天自己大声读一遍,觉得哪里读着别扭就继续改,直到读起来像你自己在说话。

说到底,最好的“降AI”方式,就是让文字真正变成你自己的。那些你真正有感触的地方、你亲自经历的细节、你发自内心的看法,AI写不出来,检测系统也识别不了。与其纠结怎么躲检测,不如把精力放在怎么把内容写得更好上——这才是一劳永逸的办法。

上海羊羽卓进出口贸易有限公司

上海羊羽卓进出口贸易有限公司