一、开篇引入:Neo AI助手为何值得关注

当前,AI编程工具已成为企业研发效能提升的关键变量,头部企业代码采纳率普遍超过40%-。据Sonar最新开发者调查报告,AI编码工具已成为主流生产力工具,72%的开发者实现每日使用,AI生成或辅助代码占比已达42%,较2023年的6%大幅跃升-。在这一浪潮中,Neo AI助手凭借其独特的技术架构和产品定位,正在智能对话与智能体领域崭露头角。

许多学习者在接触AI助手相关技术时普遍存在几个痛点:只会调用API却不懂底层实现逻辑、概念术语一知半解容易混淆、面试中被问到原理性问题答不上来、对图数据库与RAG的结合方式理解模糊。本文将以Neo AI助手为技术样本,从痛点切入、概念拆解、代码示例到面试要点,由浅入深地梳理智能对话助手的完整技术链路,帮助读者建立从“会用”到“懂原理”的知识体系。

二、痛点切入:传统对话系统为什么不够“智能”

传统实现方式的问题

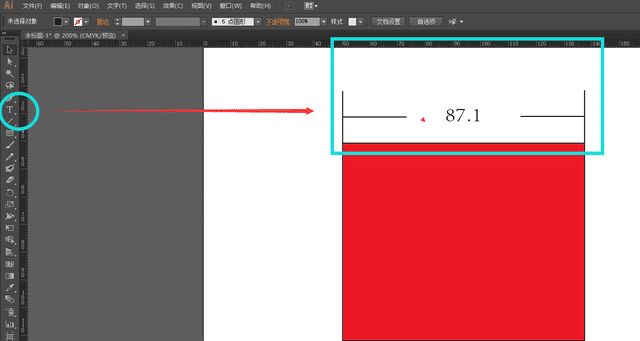

先看一个典型的传统对话机器人实现:

传统无状态对话机器人(伪代码) def chat(user_input, session_id): 每次对话都是独立的,不知道你是谁 response = llm.generate(user_input) return response

这种实现暴露了明显的短板:每次对话都从零开始,用户需要反复自我介绍;跨会话信息无法保留,上个月的聊天内容今天完全不记得;无法理解实体间关系,系统不能回答“上周和我聊天的那个产品经理喜欢什么颜色”这类依赖关系推理的问题。

Neo AI助手的解决思路

Neo AI助手正是为破解这些痛点而生——它引入长期记忆引擎和关系图谱,让对话从“无状态请求-响应”升级为“有记忆、懂关系”的智能体系统-2。

三、核心概念讲解:长期记忆引擎(Long-term Memory Engine)

标准定义

长期记忆引擎是指AI系统能够跨会话、跨时间维度保存和检索用户信息、交互记录及实体关系的能力单元,核心目标是实现真正个性化的智能对话体验。

拆解与类比

可以把这个概念拆解为三个关键词:长期(跨会话持久化)、记忆(信息存储与检索)、引擎(驱动这一能力的技术机制)。

用生活场景来类比:传统对话系统像一个每次见面都问“你叫什么名字”的陌生人;而具备长期记忆引擎的Neo AI助手,则像一位熟悉的老朋友——记得你的名字、职业、喜好,还能在你提及某人时联想到你们之间的关系。这种“懂你”的体验,正是长期记忆引擎的核心价值。

作用与价值

实现真正的个性化对话:无需用户重复信息

跨会话连续性:今天聊的话题,下周可以自然接续

上下文理解深度提升:不仅知道“你是谁”,还知道“你和他/她的关系”

四、关联概念讲解:RAG(检索增强生成)

标准定义

RAG(Retrieval-Augmented Generation,检索增强生成) 是一种将信息检索与文本生成相结合的AI技术框架。它在LLM生成回答之前,先从外部知识库中检索相关信息,再将检索结果与用户问题一同输入LLM进行生成。

RAG与长期记忆引擎的关系

这里是一个常见的概念辨析点:

| 维度 | 长期记忆引擎 | RAG |

|---|---|---|

| 定位 | 能力目标/设计思想 | 技术手段/实现方式 |

| 关注点 | 记住什么、为什么记 | 怎么存、怎么查 |

| 存储载体 | 可选用图数据库、向量库等 | 常用向量数据库 |

| 检索方式 | 可以是语义检索、关系检索等 | 以向量相似度检索为主 |

一句话概括关系:Neo AI助手的长期记忆引擎是“目标”,RAG是实现这个目标的“工具之一”——它负责将用户的历史信息和实体关系高效检索出来,供大模型生成上下文相关的回答。

简单示例说明运行机制

用户输入:“帮我回忆一下上周我和Elon讨论的项目” Step 1 - 检索:RAG从图数据库/向量库中检索相关实体 → 找到“Elon Musk”节点 → 找到“项目A”节点 → 找到“上周讨论”的关系边 Step 2 - 增强:将检索结果拼接到Prompt中 → “用户上周与Elon Musk讨论了项目A,项目A的核心需求是...” Step 3 - 生成:LLM基于增强后的上下文生成回答 → “您上周和Elon讨论的项目A主要涉及图数据库的性能优化方案...”

五、概念关系与区别总结

逻辑关系总结:

长期记忆引擎 = “做什么”(设计目标:让AI能记住)

RAG + 图数据库 = “怎么做”(实现手段:检索 + 存储)

图数据库(Neo4j) = “存在哪”(数据载体:存实体与关系)

LLM(DeepSeek) = “谁思考”(智能核心:理解与生成)

一句话记忆:“Neo AI助手用RAG从图数据库里把记忆找回来,喂给大模型让他变成懂你的朋友。”

易混淆点强调:RAG不等于长期记忆——RAG是检索机制,长期记忆是系统能力;一个系统可以既有RAG又没有真正的长期记忆(如果只做单次检索不做跨会话持久化)。

六、代码示例:Neo AI助手核心流程演示

基于Neo AI助手公开的技术栈(前端React 19 + Vite,后端Node.js + Express 5,数据库neo4j-driver,LLM选用DeepSeek),以下为核心消息处理流程的核心逻辑示意-2:

// 消息处理核心流程(简化示例) // 后端 Node.js + Express + neo4j-driver async function handleMessage(userId, userInput) { // 1. 短期记忆:获取最近对话历史(最多20轮) const recentHistory = await getChatHistory(userId, 20); // 2. 情感分析:记录用户情绪变化(最多50条) const emotion = await analyzeEmotion(userInput); await saveEmotionHistory(userId, emotion); // 3. 长期记忆检索(RAG + 图数据库) // 从 Neo4j 中检索与该用户相关的实体及其关系 const relatedEntities = await neo4j.query(` MATCH (u:User {id: $userId})-[r:RELATED_TO]-(e) RETURN e.name, type(r), e.properties `, { userId }); // 4. 实体消歧:合并同一实体的不同称呼 // 如“Elon Musk”与“马斯克”自动识别为同一实体 const disambiguated = entityDisambiguation(relatedEntities); // 5. 构建增强Prompt(RAG核心) const enhancedPrompt = buildPrompt({ input: userInput, history: recentHistory, memories: disambiguated, emotion: emotion }); // 6. 调用大模型生成(DeepSeek) const response = await llm.generate(enhancedPrompt); // 7. 记忆存储:将本次交互中的新信息存入图数据库 await storeNewMemories(userId, userInput, response); // 8. 流式输出返回 return streamResponse(response); }

关键注解:

短期记忆(recentHistory):维护当前会话的上下文连贯性

长期记忆检索(relatedEntities):RAG的关键步骤,从图数据库拉取历史关联信息

实体消歧(entityDisambiguation):将“马斯克”和“Elon Musk”视为同一人,避免记忆碎片化

记忆存储(storeNewMemories):新知识写回图数据库,实现记忆的持续更新

七、底层原理与技术支撑点

1. 图数据库(Neo4j)——关系存储的基石

Neo AI选择Neo4j作为底层存储,核心原因在于关系是一等公民。传统关系型数据库用外键表达关系需要JOIN多张表,而图数据库以节点(实体)和边(关系)的方式直接建模,查询“用户A与实体B之间有什么关联”这类关系密集型问题时性能优势显著-2。

2. RAG(检索增强生成)——记忆检索的引擎

RAG的工作流程分为两阶段:索引阶段将对话记录、实体信息向量化存入数据库;检索阶段根据当前问题计算语义相似度,召回最相关的K条记忆。这背后依赖Embedding模型将文本转换为向量,以及向量相似度计算(如余弦相似度)。

3. 实体消歧(Entity Disambiguation)——记忆去重的关键

用户可能在对话中用不同方式指代同一实体(“Elon Musk” vs “马斯克” vs “埃隆”)。实体消歧算法通过规则匹配或语义相似度计算,自动合并这些指代,避免形成“记忆碎片”,这是实现高质量长期记忆的前提-2。

4. WebSocket长连接——实时交互的保障

Neo AI通过WebSocket与飞书等平台建立持久连接,相比传统的HTTP短连接,能够实现实时消息推送和流式输出(Streaming),即大模型边生成边输出,用户无需等待全部生成完成即可看到回复-2。

5. 大语言模型(LLM)——智能对话的“大脑”

Neo AI选用DeepSeek作为底层LLM,负责语义理解、意图识别和回答生成。LLM是整个系统的“思考中枢” ,但它的能力依赖于RAG提供的上下文——没有记忆检索,LLM就是一个“博学但健忘”的对话者。

八、高频面试题与参考答案

1. 问:RAG和Fine-tuning在构建AI助手时如何选择?

参考答案(踩分点:场景区分 + 优势分析):

RAG适合:知识需要频繁更新(如新闻、企业内部文档)、需要溯源引用、不需要额外训练成本的场景。优势:动态更新成本低、可解释性强。

Fine-tuning适合:需要模型学习特定风格或行为模式(如特定口吻、专业领域术语)、私有数据量充足的场景。优势:模型更“专”、推理速度更快。

结合使用:常见实践是两者结合——用Fine-tuning塑造模型的基础能力和风格,用RAG引入动态知识。

2. 问:长期记忆引擎在AI系统中如何实现?

参考答案(踩分点:分层架构 + 技术选型):

长期记忆引擎通常采用分层存储架构:

短期记忆层:缓存当前会话的对话历史(如Redis)

长期记忆层:持久化存储用户偏好、实体关系等信息(如图数据库Neo4j或向量数据库)

检索层(RAG) :根据当前用户输入,从长期记忆中检索相关信息,拼接到Prompt中

写入层:每次对话结束后,提取新信息写入长期存储

Neo AI助手采用Neo4j图数据库+RAG方案,利用图结构天然表达实体间关系的优势实现高效的长期记忆-2。

3. 问:什么是实体消歧?为什么在AI助手中重要?

参考答案(踩分点:定义 + 作用 + 后果):

实体消歧是指识别和合并同一实体的不同指代方式(如同义消歧)。重要性在于:避免记忆碎片化。若不做消歧,系统可能将“Elon Musk”和“马斯克”当成两个独立的人,导致记忆混乱、回答不准确。Neo AI通过内置实体解析算法自动合并不同指代-2。

4. 问:WebSocket在AI助手中的作用是什么?

参考答案(踩分点:对比HTTP + 实际价值):

WebSocket提供全双工持久连接,相比HTTP短连接的优势:

实时性:服务端可主动推送消息

流式输出:大模型边生成边返回,用户体验更好

低延迟:省去重复建立连接的开销

Neo AI利用WebSocket实现与飞书平台的长连接,支撑实时消息接收和打字机式流式输出-2。

5. 问:图数据库相比关系型数据库在AI助手中的优势是什么?

参考答案(踩分点:关系查询效率 + 建模自然性):

关系查询效率:图数据库中查找“用户A与实体B之间的所有关系”是O(1)级别的指针遍历,而关系型数据库需要多表JOIN,复杂度随关系深度指数增长

建模自然性:实体(节点)+关系(边)的模型更贴近现实世界的认知方式,适合存储人与人、人与事之间的复杂关系网络

Neo AI的应用:利用图数据库存储用户信息、交互历史及实体关联,支撑长期记忆引擎-2

九、结尾总结

核心知识点回顾:

| 概念 | 一句话总结 | 易错提醒 |

|---|---|---|

| 长期记忆引擎 | AI跨会话保留用户信息的系统能力 | 不等于RAG,是目标而非手段 |

| RAG | 检索增强生成,是实现记忆检索的技术手段 | 只解决“查”的问题,不解决“存”的问题 |

| 实体消歧 | 合并同一实体的不同称呼 | 不做消歧会导致记忆碎片化 |

| 图数据库 | 以节点和边存储实体关系 | 适合关系密集型查询,不适合大文本存储 |

| WebSocket | 全双工长连接,支撑实时交互 | 注意连接管理和重连机制 |

易错点强调:

不要混淆“长期记忆”和“RAG”——前者是能力目标,后者是实现手段

不要忽略实体消歧——没有它,记忆再多也是碎片

不要以为图数据库能替代向量数据库——两者各司其职,关系检索用图、语义检索用向量

进阶预告:

下一篇将深入讲解Neo AI中的Agent能力设计——从MCP(Model Context Protocol)服务支持到跨系统工具调用、从记忆自我管理到自主任务调度-1。感兴趣的同学可以持续关注。

本文基于2026年4月的最新公开技术资料整理,旨在帮助技术学习者和开发者建立AI助手核心能力的系统认知。

📌 面试速记卡

长期记忆 vs RAG:目标 vs 工具

实体消歧:一人多名 → 自动合并 → 避免碎片

图数据库:关系是连边,查询用遍历

WebSocket:持久连接 + 流式输出 = 实时体验

上海羊羽卓进出口贸易有限公司

上海羊羽卓进出口贸易有限公司